You are here

8/11(金)放送 TV東京「ガイアの夜明け【AIは天使か悪魔か】」に横田教授が出演

2023.08.16

8/11(金)放送 TV東京「ガイアの夜明け【AIは天使か悪魔か】」に横田教授が出演

GPTなどの言語生成モデルやStableDiffusionなどの画像生成モデルに代表される生成AIはこれからの社会に大きな変革をもたらす技術として期待されています。近年の基盤モデルと呼ばれるものは、膨大なデータで事前学習を行うことで様々なタスクに応用できるようになってきています。ただし、このような事前学習には膨大な計算資源が必要になります。

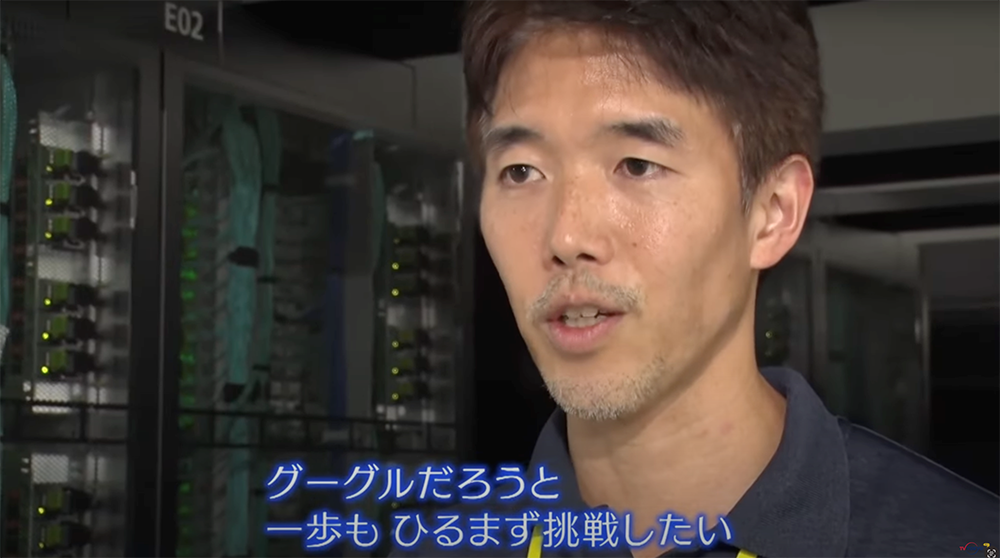

GPT-Fugakuプロジェクトでは、東京工業大学・学術国際情報センターの横田理央教授がリーダーとなり、HPCIの政策対応枠を利用し、東北大学、理化学研究所、富士通などが協力することで、スーパーコンピュータ「富岳」上で大規模な事前学習を行うための並列化・高速化技術の開発を行います。2023年8月11日(金)のTV東京の「ガイアの夜明け」では、このような取り組みを取り上げ、横田教授が理研や富士通の共同研究者らと議論する場面やサイバーエージェントとデータ利用に関する交渉をする場面などが放映されました。

リンク

- 「富岳」政策対応枠

https://www.hpci-office.jp/application/files/8616/8471/1584/press_20230522.pdf

- ガイアの夜明け

https://www.tv-tokyo.co.jp/gaia/

- 横田研究室

日本語

![[GSIC]東京工業大学学術国際情報センター(学際大規模情報基盤共同利用・共同研究拠点)](../_img/logo.jpg)